,著眼Python、统计数据挖掘、统计数据挖掘、有趣辅助工具!

现如今,数学模型数学模型早已十分深入细致和繁杂,须要自学很多的权重股。体能训练这类数学模型十分具备诱惑力。统计数据生物学家须要创建分布式系统体能训练,检查点等。即便如此,统计数据自然科学专业人士也可能将难以达至平庸的操控性和发散速率。体能训练小型数学模型极具诱惑力,即使数学模型很难用尽缓存。

在责任编辑中,我将撷取 10 个 Python 架构条目,那些架构使他们能对分布式系统和并行化广度自学数学模型有更真切的知觉。

沟通交流群

1、Elephas

Elephas 是 Keras 的扩充,它能采用 Spark 小规模运转分布式系统广度自学数学模型。 Elephas 维持了 Keras 的单纯性和可扩展性,进而容许对分布式系统数学模型展开加速蓝本制做,该数学模型能在海量统计数据K568运转。 Elephas 现阶段全力支持很多插件,主要包括:广度自学数学模型的统计数据博戈达体能训练分布式系统超模块强化软件系统数学模型的分布式系统体能训练。

加装

Github 镜像

2、FairScale

FairScale 是 PyTorch 扩充库,用作在两台或几台电脑/结点上展开高效能和小规模专业培训。该库扩充了基本上的PyTorch机能,与此同时加进了捷伊试验机能。 FairScale全力支持:

博戈达新溪洲体能训练小规模强化GPU缓存强化GPU速率强化加装

Github 镜像

3、TensorFlowOnSpark

通过将TensorFlow广度自学架构中的突出机能与Apache Spark和Apache Hadoop相结合,TensorFlowOnSpark能在GPU和CPU服务器集群上实现分布式系统广度自学。

它全力支持在Spark集群上展开分布式系统TensorFlow体能训练和推理,其目标是最大程度地减少在共享网格上运转现有TensorFlow程序所需的代码更改量。

TensorFlowOnSpark由Yahoo开发,用作在Yahoo私有云中的Hadoop集群上展开小规模分布式系统广度自学。

加装

Github 镜像

4、DeepSpeed

DeepSpeed 是一个广度自学强化库,它使分布式系统体能训练变得难、高效和有效。

DeepSpeed为所有人提供了极端规模的数学模型体能训练,从在小型超级计算机上展开体能训练到在低端群集甚至在单个GPU上展开体能训练的人员:

极端规模:将现阶段的GPU群集与数百种设备结合采用,实现3D博戈达 DeepSpeed 能有效地体能训练具备数万亿模块的广度自学数学模型。极高的缓存效率:DeepSpeed 的ZeRO-Offload 仅需一个 GPU,即可体能训练超过10B模块的数学模型,比现有技术大10倍,使数十亿模块的数学模型体能训练民主化,进而使很多广度自学生物学家能探索更大更好的数学模型。Github 镜像

5、Horovod

Horovod 是一个针对TensorFlow,Keras,PyTorch和Apache MXNet的分布式系统广度自学体能训练架构。

Horovod的目标是使分布式系统广度自学加速且易于采用。一旦采用Horovod编写了可扩充的专业培训脚本,它就能在单GPU,多GPU甚至是多个主机上运转,而无需展开任何其他代码更改。

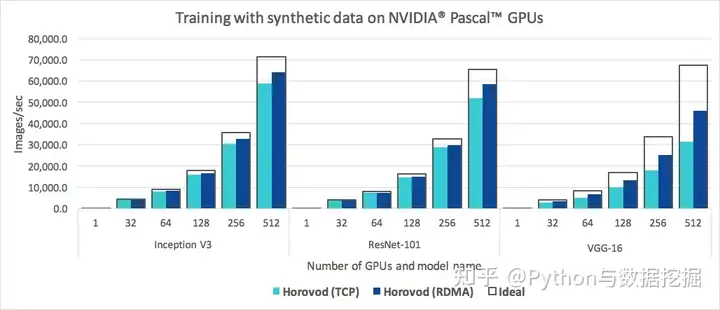

除了易于采用之外,Horovod速率也很快。 下面的图表表示基准测试是在128个服务器上完成的,该服务器具备 4 个 Pascal GPU,每个GPU均通过全力支持RoCE的 25 Gbit/s网络连接:

加装

Github 镜像

6、Mesh TensorFlow

Mesh TensorFlow(mtf)是一种用作分布式系统广度自学的语言,能指定广泛的分布式系统张量计算类。Mesh TensorFlow的目的是为硬件/处理器上的计算图形式化并实施分配策略。

例如:将批处理拆分成多个处理器行,并将隐藏层中的各个单元拆分成多个处理器列。Mesh TensorFlow被实现为 TensorFlow 上的一层。

加装

Github 镜像

7、BigDL

BigDL 是 Apache Spark 的分布式系统广度自学库,采用 BigDL,用户能将其广度自学插件编写为标准 Spark 程序,那些程序能直接在现有Spark或Hadoop集群上运转。

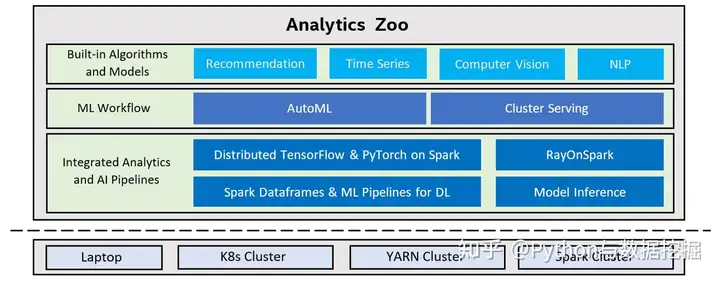

为了简化构建Spark和BigDL插件的过程,提供了一个高级Analytics Zoo,用作端到端Analytics AI管道:

丰富的广度自学全力支持。高效能有效地横向扩充加装

Github 镜像

8、Analytics Zoo

Analytics Zoo 无缝地将TensorFlow,Keras和PyTorch扩充为分布式系统大统计数据。

用作将AI数学模型应用作分布式系统大统计数据的端到端管道,采用Spark代码内联编写TensorFlow或PyTorch,以展开分布式系统体能训练和推理Spark ML管道中的本机广度自学(TensorFlow / Keras / PyTorch / BigDL)全力支持可扩充的AutoML用作时间序列预测加装

Github 镜像

9、Petastorm

Petastorm 是由 Uber ATG 开发的开源统计数据访问库。该库全力支持直接从Apache Parquet格式的统计数据集中展开单机或分布式系统专业培训以及对广度自学数学模型的评估。

Petastorm全力支持流行的基于Python的电脑学习(ML)架构,例如Tensorflow,PyTorch和PySpark。也能从纯Python代码中采用它。

加装

Github 镜像

10、Apache SINGA

Apache SINGA 是一个 Apache 顶级项目,致力于广度自学和电脑自学数学模型的分布式系统专业培训。

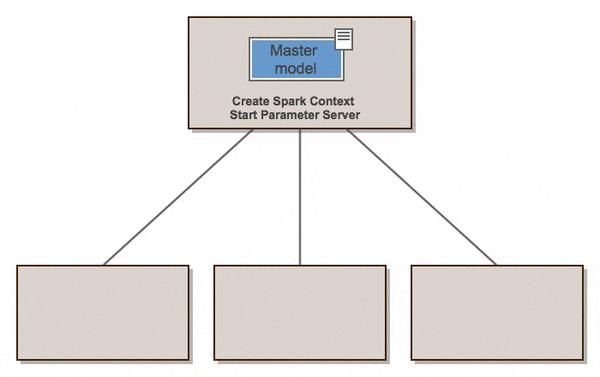

可扩充性:SINGA使专业培训博戈达化并强化通信成本,以提高专业培训的可扩充性。效率:SINGA创建计算图以强化体能训练速率和缓存占用。可用性:SINGA具备单纯的软件堆栈和Python界面以提可扩展性。加装

官方镜像

推荐阅读

李航老师《统计自学方法(第二版)》课件 & 算法代码全公开了!

收获3200星,这个GitHub项目帮你从头开始自学统计数据自然科学!

蔬果 | 2021年机器自学不容错过的14个博客

2021年了,Python开发者不容错过的7个VS Code扩充

项目在手,天下我有!撷取 820个电脑自学、Python实战项目!

整